在當今數據驅動的時代,高效、可靠的存儲與檢索技術是數據處理服務的基石。日志結構合并樹(Log-Structured Merge-Tree,簡稱LSM樹)作為一種經典的存儲引擎設計,因其出色的寫入性能和高吞吐量,被廣泛應用于NoSQL數據庫(如LevelDB、RocksDB、Cassandra)和大數據系統中。本文將通過一個LSM樹的實現案例,深入剖析其核心原理,并探討其在現代數據處理與存儲服務中的應用架構。

一、LSM樹核心原理回顧

LSM樹的核心思想是將隨機寫入轉換為順序寫入,從而充分利用磁盤順序I/O的高性能。其基本結構通常包含兩部分:

- 內存組件(MemTable):一個駐留在內存中的有序數據結構(如跳表、AVL樹或紅黑樹),用于接收所有新的寫入和更新操作。當MemTable達到一定大小閾值后,它會被標記為不可變的(Immutable MemTable),并準備刷寫到磁盤。

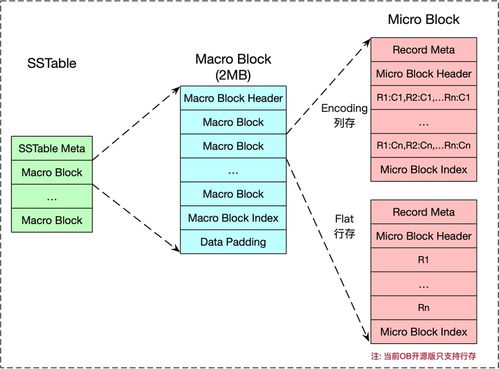

- 磁盤組件(SSTable - Sorted String Table):不可變的MemTable被順序寫入磁盤,形成一個個按Key排序的、不可變的數據文件,即SSTable文件。這些SSTable文件被組織成多層(Level),通常越往下的層級,包含的數據范圍越廣,文件也越大。

LSM樹通過后臺的“合并”(Compaction)進程,將多個小的、可能存在重疊Key范圍的SSTable文件合并成更大、更有序的新文件,并清理已刪除或過時的數據,從而控制讀放大和空間放大問題。

二、一個簡化的LSM樹實現案例

假設我們正在構建一個輕量級的鍵值存儲引擎。以下是其核心模塊的簡化實現思路:

1. 內存表(MemTable)實現

- 使用并發跳表(Concurrent SkipList)作為內存數據結構,支持高并發插入與查找。

- 每個寫入操作(Put/Delete)都被追加到一個預寫日志(Write-Ahead Log, WAL)中以確保持久性,然后插入MemTable。

- 當MemTable大小超過預設值(如64MB),將其狀態轉為只讀,并創建一個新的活躍MemTable接收后續寫入。舊的MemTable則被調度進行刷盤。

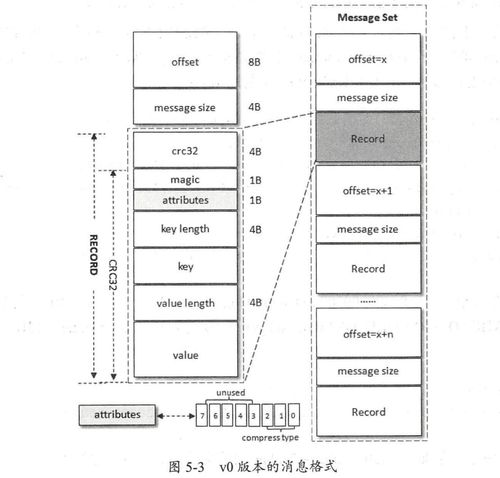

2. SSTable文件格式與刷盤

- 不可變MemTable被遍歷,生成按Key排序的數據塊序列。

- 每個SSTable文件包含:數據塊區、元數據索引區(記錄每個數據塊的起始Key和文件偏移)、布隆過濾器(Bloom Filter)和文件尾部元數據(如版本、壓縮類型)。

- 刷盤過程是順序I/O,速度極快。刷盤完成后,對應的WAL日志可以被安全刪除。

3. 多級存儲與合并策略

- 我們采用類似LevelDB的分層策略。Level 0(L0)存放直接從MemTable刷新的SSTable,允許文件間Key范圍重疊。

- Level 1及以上(L1, L2...)的每個層級有明確的大小限制,且同一層內的SSTable文件必須保證Key范圍不重疊。

- 當某一層的數據量超過閾值時,觸發合并操作。例如,從L0中選擇一個文件,與L1中Key范圍有重疊的所有文件進行多路歸并排序,生成新的SSTable文件寫入L1。L1到L2的合并同理。這種策略在寫入放大、讀放大和空間放大之間取得平衡。

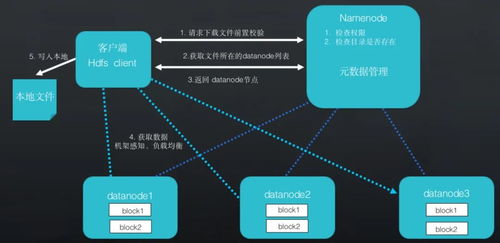

4. 讀取流程

- 讀取一個Key時,首先查詢活躍的MemTable。

- 若未找到,則依次查詢不可變MemTable。

- 若仍未命中,則從磁盤層級中查找。利用每個SSTable附帶的布隆過濾器可以快速跳過不可能包含該Key的文件。從L0開始,由于L0文件有重疊,可能需要查詢多個文件;對于更高層級,由于Key范圍不重疊,通常每個層級最多只需查詢一個文件。

- 找到Key對應的最新版本數據后返回(刪除標記則返回“未找到”)。

三、集成于數據處理與存儲服務

將上述LSM樹引擎作為核心存儲層,我們可以構建一個完整的數據處理與存儲服務。該服務架構可能包含以下組件:

- API服務層:提供RESTful或gRPC接口,接收客戶端的PUT、GET、DELETE、SCAN等操作請求。

- 請求處理與路由層:對于分布式部署,此層負責根據Key進行分片路由,將請求轉發到正確的存儲節點。

- 核心存儲引擎(LSM樹實例):每個存儲節點運行一個或多個LSM樹實例,管理本節點的數據。可以配置不同的合并策略、壓縮算法(如Snappy、Zstd)以適應不同工作負載(寫密集、讀密集或混合)。

- 高可用與復制:通過主從復制(如Raft、Paxos共識算法)或多副本機制,將數據同步到多個節點,確保服務可用性與數據持久性。WAL日志在復制中扮演關鍵角色。

- 后臺服務:

- 合并調度器:持續監控各級別SSTable數量與大小,智能調度合并任務,避免影響前臺I/O。

- 快照與備份:定期創建SSTable文件的快照,并備份到對象存儲(如S3)以實現災難恢復。

- 監控與調優:收集性能指標(如寫入延遲、讀取延遲、合并I/O量),為動態調整參數(如MemTable大小、合并觸發閾值)提供依據。

四、優勢與挑戰

優勢:

- 極高的寫入吞吐量:得益于順序寫入和批量刷盤。

- 良好的空間局部性:SSTable文件有序且壓縮,節省存儲空間。

- 適應海量數據:層級結構便于管理遠超內存容量的數據集。

挑戰與優化方向:

- 讀放大:一次查詢可能涉及多個SSTable文件。優化手段包括精心設計合并策略、使用布隆過濾器、引入塊緩存(Block Cache)和行緩存(Row Cache)。

- 寫放大:合并過程可能重寫大量數據。采用分層大小比例調優、選擇更智能的合并算法(如RocksDB的通用合并)可以緩解。

- 空間放大:舊版本數據在被合并清理前會暫時占用空間。通過調整數據保留策略和控制合并頻率來管理。

結論

LSM樹通過其獨特的設計,在犧牲部分讀取性能的前提下,換來了卓越的寫入性能,非常適合寫多讀少、數據量持續增長的應用場景。從LevelDB到RocksDB,工業界的持續優化證明了其強大的生命力。理解并實現一個LSM樹案例,是深入掌握現代數據庫存儲內核的關鍵一步。將其融入一個完整的數據處理與存儲服務架構中,則需要綜合考慮分布式、一致性、高可用等系統工程問題,從而構建出穩定、高效、可擴展的數據基礎設施。